VS Code와 Ollama를 연동하면 외부 클라우드(ChatGPT, Claude 등)에 데이터를 보내지 않고도 **로컬 환경에서 무료로 AI 코딩 보조 도구(Copilot 대안)**를 사용할 수 있습니다.

가장 대중적이고 강력한 도구인 ‘Continue’ 확장을 중심으로 연동 방법을 정리해 드립니다.

1. Ollama 설치 및 모델 다운로드

먼저 PC에 Ollama가 설치되어 있어야 합니다.

-

Ollama 설치: ollama.com에서 OS에 맞는 버전을 설치합니다.

-

모델 다운로드: 터미널(CMD 또는 PowerShell)을 열고 코딩에 최적화된 모델을 다운로드합니다.

-

추천 모델:

-

llama3.1 (일반적인 대화 및 코딩)

-

deepseek-coder-v2 (코딩 특화 성능 매우 우수)

-

codellama (메타의 코딩 모델)

-

-

명령어 입력:

Bashollama run llama3.1 # 또는 ollama run deepseek-coder-v2

-

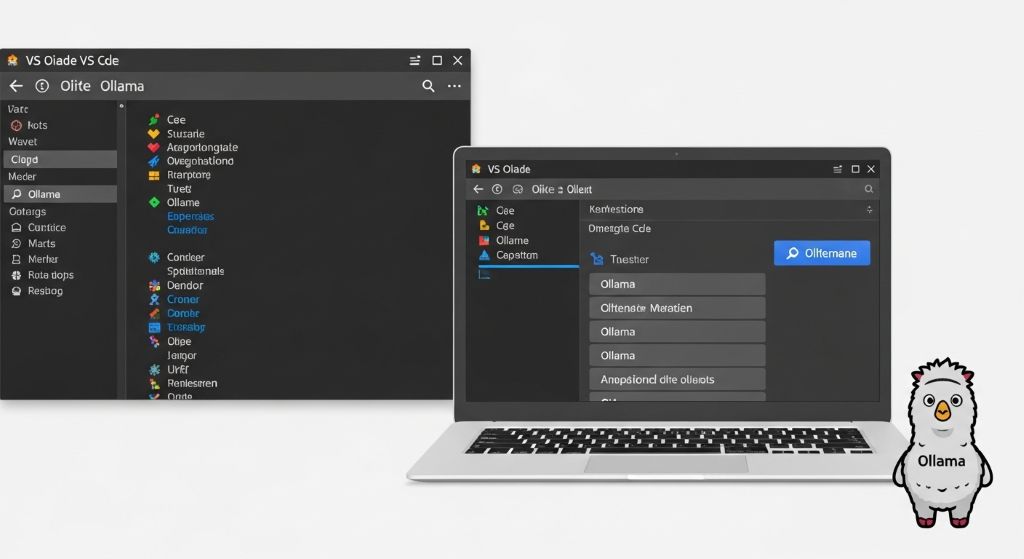

2. VS Code 확장 프로그램 설치

VS Code를 실행하고 왼쪽 확장(Extensions) 아이콘(Ctrl+Shift+X)을 클릭하여 다음 중 하나를 설치합니다.

-

Continue (가장 추천): 채팅, 코드 완성, 리팩토링 등 기능이 가장 풍부합니다.

-

Llama Coder: GitHub Copilot처럼 자동 완성(Autocomplete) 기능에 특화되어 있습니다.

-

Cline (구 Roo Code): AI 에이전트 기능을 통해 복잡한 작업을 수행할 때 좋습니다.

3. Continue 확장을 이용한 연동 설정 (상세)

설치가 완료되면 VS Code 왼쪽 사이드바에 Continue 아이콘이 생깁니다.

-

설정 파일 열기:

-

Continue 창 하단의 **톱니바퀴 아이콘(Configure)**을 클릭합니다.

-

config.json 파일이 열립니다.

-

-

Ollama 모델 추가:

models 항목에 Ollama 정보를 추가합니다. (이미 기본 예시가 있을 수 있습니다.)JSON{ "models": [ { "title": "Ollama Llama 3.1", "provider": "ollama", "model": "llama3.1" }, { "title": "DeepSeek Coder", "provider": "ollama", "model": "deepseek-coder-v2" } ], "tabAutocompleteModel": { "title": "Tab Autocomplete", "provider": "ollama", "model": "deepseek-coder-v2" } } -

저장: 파일을 저장하면 즉시 적용됩니다.

4. 주요 사용 방법

-

코드 채팅 (Ctrl + L): 코드를 드래그한 후 Ctrl + L을 누르면 해당 코드가 채팅창에 입력됩니다. “이 코드 설명해줘”, “버그 찾아줘” 등을 요청할 수 있습니다.

-

코드 수정 요청 (Ctrl + I): 편집기 내에서 Ctrl + I를 누르면 입력창이 뜹니다. “이 함수를 비동기 방식으로 바꿔줘”라고 입력하면 AI가 즉시 코드를 수정해 제안합니다.

-

자동 완성 (Tab): 코드를 작성하는 도중 AI가 흐릿하게 다음 코드를 제안합니다. Tab 키를 눌러 수락합니다.

5. 성능 최적화 팁

-

GPU 가속: Ollama는 기본적으로 GPU(NVIDIA, Apple Silicon 등)를 사용합니다. 외장 그래픽 카드가 있다면 훨씬 빠릅니다.

-

모델 크기 선택:

-

RAM 8GB 이하: deepseek-coder:1.3b 등 작은 모델 권장

-

RAM 16GB 이상: llama3.1:8b, deepseek-coder-v2:16b 권장

-

-

Ollama 서버 확인: 연동이 안 된다면 터미널에 ollama list를 입력하여 서버가 실행 중인지 확인하세요.

요약: 어떤 확장을 쓸까요?

-

종합적인 코딩 비서가 필요하다: Continue

-

오직 Copilot 같은 자동 완성만 필요하다: Llama Coder

-

AI가 내 파일을 직접 수정하고 터미널 명령까지 내리길 원한다: Cline

개인적으로는 Continue와 DeepSeek-Coder-V2 모델의 조합이 현재 로컬 환경에서 가장 만족도가 높습니다.