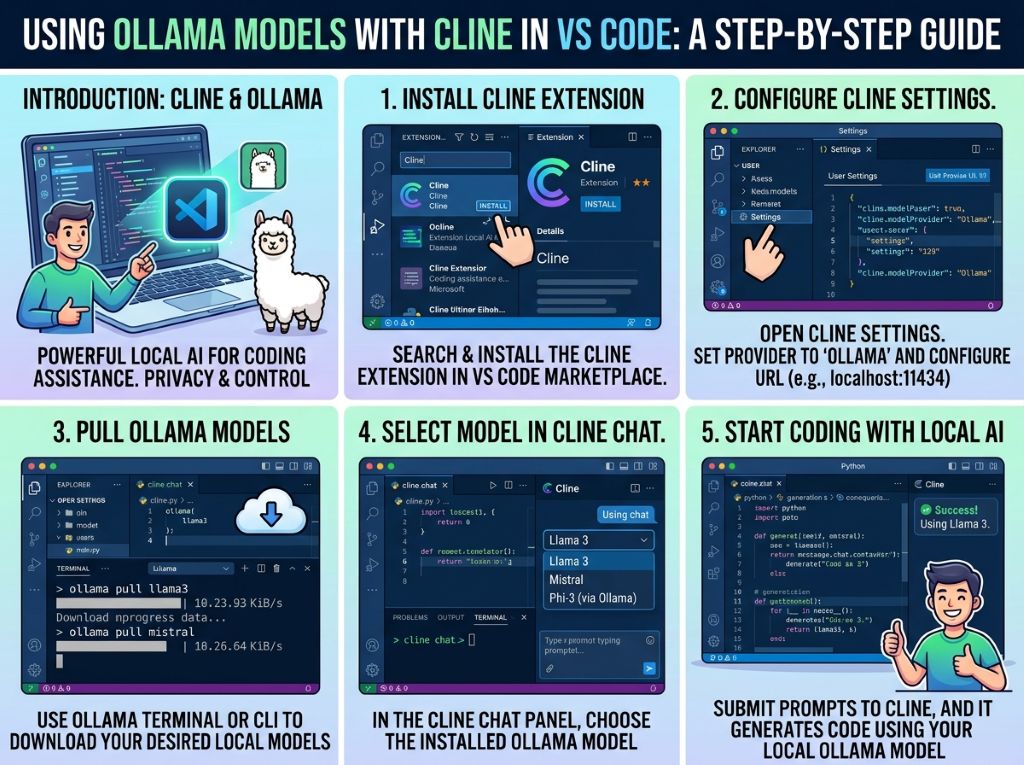

VS Code에서 Cline 확장 프로그램을 사용해 Ollama 모델을 쓰려면, Ollama 서버를 먼저 실행하고 Cline 설정에서 연결하면 됩니다. Cline은 자율 코딩 에이전트로 코드 생성·편집·실행을 지원하며, Ollama와 잘 맞습니다.

사전 준비

-

Ollama 설치 및 실행: ollama.com에서 설치 후 터미널에서

ollama serve실행합니다. -

모델 다운로드:

ollama pull codellama:7b또는ollama pull deepseek-coder:6.7b처럼 원하는 모델을 끌어옵니다. 코딩용으로qwen2.5-coder-cline:14b추천. -

Cline 확장 설치: VS Code Extensions에서 “Cline” 검색해 설치하고 재시작합니다.

Cline 설정 방법

-

설정 열기: Ctrl+Shift+P → “Cline: Open Settings” 선택하거나, 설정(Ctrl+,) → Extensions → Cline으로 갑니다.

-

Ollama 연결:

-

Provider: “ollama”.

-

Base URL:

http://localhost:11434(기본값). -

Model: 다운로드한 모델명 입력 (e.g., “codellama:7b”).

-

-

추가 옵션 (선택):

-

temperature: 0.1~0.3 (코드용 낮게).

-

maxTokens: 2048.

-

사용 예시

-

채팅 시작: Ctrl+Shift+P → “Cline: Start Chat”로 모델과 대화합니다.

-

코드 생성: 새 파일 열고 “Write a Python fibonacci function” 요청.

-

프로젝트 맥락:

enableProjectContext: true로 파일 타입 지정 (e.g., [“.py”, “.js”]).