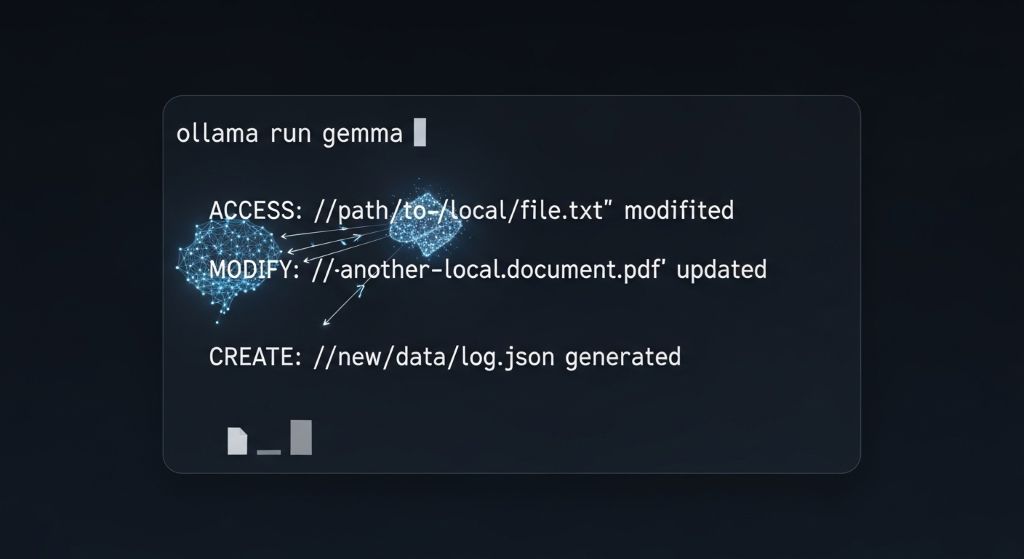

Ollama는 기본적으로 텍스트를 생성하는 엔진일 뿐, 운영체제의 파일 시스템에 접근하여 쓰기(Write) 작업을 수행하는 기능이 차단(Sandboxed)되어 있기 때문입니다.

파일을 수정하게 하려면 Ollama와 파일 시스템을 연결해 주는 **”도구(Wrapper) 프로그램”**이나 **”에이전트”**를 사용해야 합니다. 가장 추천하는 3가지 방법을 알려드립니다.

방법 1: Aider 사용하기 (가장 추천 – CLI 방식)

Aider는 터미널에서 AI와 채팅하며 내 프로젝트의 코드를 직접 수정하게 만드는 최고의 도구입니다.

-

파이썬 설치 확인: PC에 Python이 설치되어 있어야 합니다.

-

Aider 설치:

Bashpip install aider-chat -

Ollama 모델과 연결하여 실행:

프로젝트 폴더로 이동한 후, 아래 명령어를 입력합니다.Bashaider --model ollama/gemma2 -

사용법:

-

채팅창이 뜨면 /add 파일명으로 수정하고 싶은 파일을 AI에게 인식시킵니다.

-

“이 파일의 함수 A를 B로 바꿔줘”라고 말하면 AI가 직접 파일을 수정하고 Git 커밋까지 제안합니다.

-

방법 2: Open Interpreter 사용하기 (가장 강력함)

Open Interpreter는 AI가 로컬 컴퓨터에서 코드를 실행하고 터미널 명령어를 입력할 수 있게 해줍니다. (파일 생성, 수정, 삭제 가능)

-

설치:

Bashpip install open-interpreter -

실행 (로컬 Ollama 사용):

Bashinterpreter --local -

사용법:

-

실행 후 모델 선택 화면에서 Ollama를 선택하고 gemma2를 지정합니다.

-

“현재 폴더에 test.txt 파일을 만들고 내용을 ‘안녕하세요’로 채워줘”라고 명령하면 실제 명령어를 수행합니다.

-

방법 3: VS Code 확장 프로그램 (Continue)

개발자라면 코드 에디터인 VS Code 내에서 사용하는 것이 가장 편리합니다.

-

VS Code에서 확장 프로그램 탭으로 이동.

-

Continue 검색 후 설치 (무료 오픈소스).

-

설치 후 왼쪽 사이드바의 Continue 설정(config.json)에서 모델을 Ollama로 변경:

JSON"models": [ { "title": "Gemma 2", "provider": "ollama", "model": "gemma2" } ] -

사용법:

-

코드를 드래그한 후 Ctrl + I (Windows) 또는 Cmd + I (Mac)를 누릅니다.

-

“이 코드를 ~게 수정해줘”라고 입력하면 AI가 수정안을 제시하고, 수락하면 파일이 변경됩니다.

-

요약

-

터미널에서 바로 수정하고 싶다면: 👉 Aider (가장 깔끔하고 코딩에 최적화됨)

-

파일 수정뿐만 아니라 시스템 조작도 하고 싶다면: 👉 Open Interpreter

-

코드 에디터 안에서 편하게 쓰고 싶다면: 👉 VS Code + Continue

이 중 하나를 선택하여 설치하시면 Gemma2 모델을 통해 파일을 직접 제어하실 수 있습니다.